Что такое краулинг и как управлять роботами

Выдача ответов на поисковый запрос на странице поиска за долю секунды только верхушка айсберга. В «черном ящике» поисковых систем — просканированные и занесенные в специальную базу данных миллиарды страниц, которые отбираются для представления с учетом множества факторов.

Страница с результатами поиска формируется в результате трех процессов:

- сканирования;

- индексирования;

- предоставления результатов (состоит из поиска по индексу и ранжирования страниц).

В этом выпуске «Азбуки SEO» речь пойдет о сканировании или краулинге страниц сайта.

Как работает сканирование (краулинг) сайта?

Если кратко, краулинг (сканирование, crawling) — процесс обнаружения и сбора поисковым роботом (краулером) новых и обновленные страницы для добавления в индекс поисковых систем. Сканирование — начальный этап, данные собираются только для дальнейшей внутренней обработки (построения индекса) и не отображаются в результатах поиска. Просканированная страница не всегда оказывается проиндексированной.

Поисковый робот (он же crawler, краулер, паук, бот) — программа для сбора контента в интернете. Краулер состоит из множества компьютеров, запрашивающих и выбирающих страницы намного быстрее, чем пользователь с помощью своего веб-браузера. Фактически он может запрашивать тысячи разных страниц одновременно.

Что еще делает робот-краулер:

- Постоянно проверяет и сравнивает список URL-адресов для сканирования с URL-адресами, которые уже находятся в индексе Google.

- Убирает дубликаты в очереди, чтобы предотвратить повторное скачивание одной и той же страницы.

- Добавляет на переиндексацию измененные страницы для предоставления обновленных результатов.

При сканировании пауки просматривают страницы и выполняют переход по содержащимся на них ссылкам так же, как и обычные пользователи. При этом разный контент исследуется ботами в разной последовательности. Это позволяет одновременно обpaбатывать огромные массивы данных.

Например, в Google существуют роботы для обработки разного типа контента:

- Googlebot — основной поисковый робот;

- Googlebot News — робот для сканирования новостей;

- Googlebot Images — робот для сканирования изображений;

- Googlebot Video — робот для сканирования видео.

Что такое robots.txt и зачем вообще нужен индексный файл В

Кстати, именно с robots.txt и начинается процесс сканирования сайта — краулер пытается обнаружить ограничения доступа к контенту и ссылку на карту сайта (Sitemap). В карте сайта должны находиться ссылки на важные страницы сайта. В некоторых случаях поисковый робот может проигнорировать этот документ и страницы попадут в индекс, поэтому конфиденциальную информацию нужно закрывать паролем непосредственно на сервере.

Просматривая сайты, бот находит на каждой странице ссылки и добавляет их в свою базу. Робот может обнаружить ваш сайт даже без размещения ссылок на него на сторонних ресурсах. Для этого нужно осуществить переход по ссылке с вашего сервера на другой. Заголовок HTTP-запроса клиента «referer» будет содержать URL источника запроса и, скорее всего, сохранится в журнале источников ссылок на целевом сервере. Следовательно, станет доступным для робота.

Истории бизнеса и полезные фишки

Как краулер видит сайт

Если хотите проверить, как робот-краулер видит страницу сайта, отключите обработку JavaScript при включенном отладчике в браузере. Рассмотрим на примере Google Chrome:

1. Нажимаем F12 — вызываем окно отладчика, переходим в настройки.

2. Отключаем JavaScript и перезагружаем страницу.

Если в целом на странице сохранилась основная информация, ссылки на другие страницы сайта и выглядит она примерно так же, как и с включенным JavaScript, проблем со сканированием не должно возникнуть.

Второй способ — использовать инструмент Google «Просмотреть как Googlebot» в Search Console.

Если краулер видит вашу страницу так же, как и вы, проблем со сканированием не возникнет.

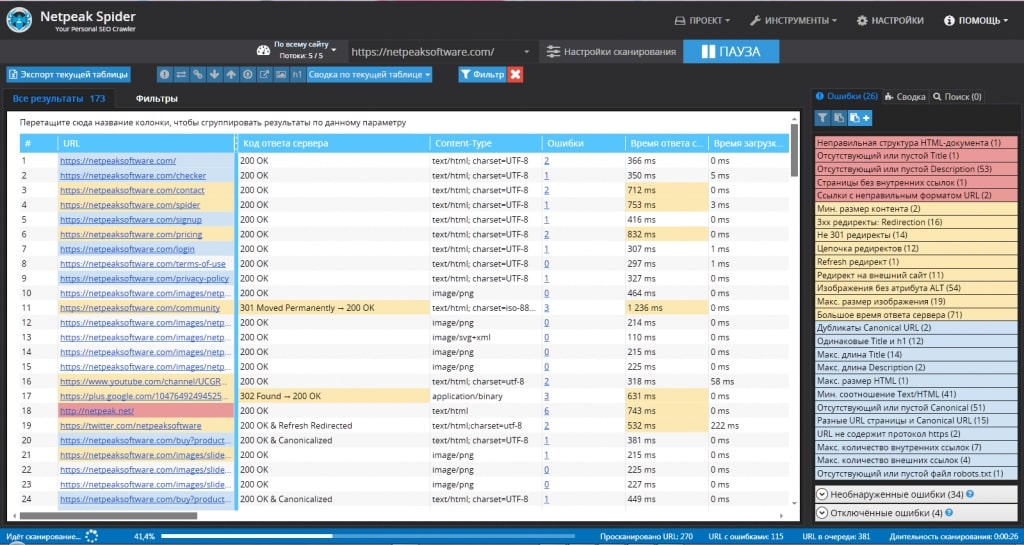

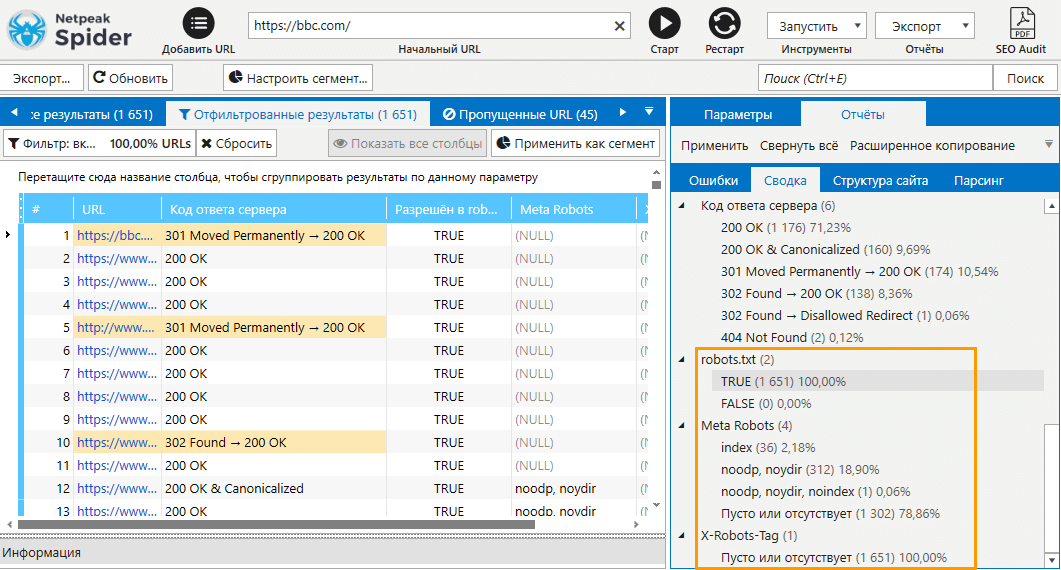

Третий метод — специальное программное обеспечение. Например https://pr-cy.ru/simulator/ отображает программный код, который робот видит на странице, а Netpeak Spider показывает более 50 разных видов ошибок, найденных при сканировании, и разделяет их по степени важности.

Если страница не отображается так, как вы ожидали, стоит проверить, доступна ли она для сканирования: не заблокирована ли она в robots.txt, в файле .htaccess.

Сайт на Ajax: как отдельным страницам попасть в выдачу Проблемы со сканированием могут возникать, если сайт создан с помощью технологий

Как управлять сканированием страниц

Запуск и оптимизация сканирования сайта

Существует несколько методов пригласить робота-паука к себе на сайт:

- Разрешить сканирование сайта, если он был запаролен на сервере, и передать информацию об URL c помощью HTTP-заголовка «referer» при переходе на другой ресурс.

- Разместить ссылку на ваш сайт на другом ресурсе, например, в соцсетях.

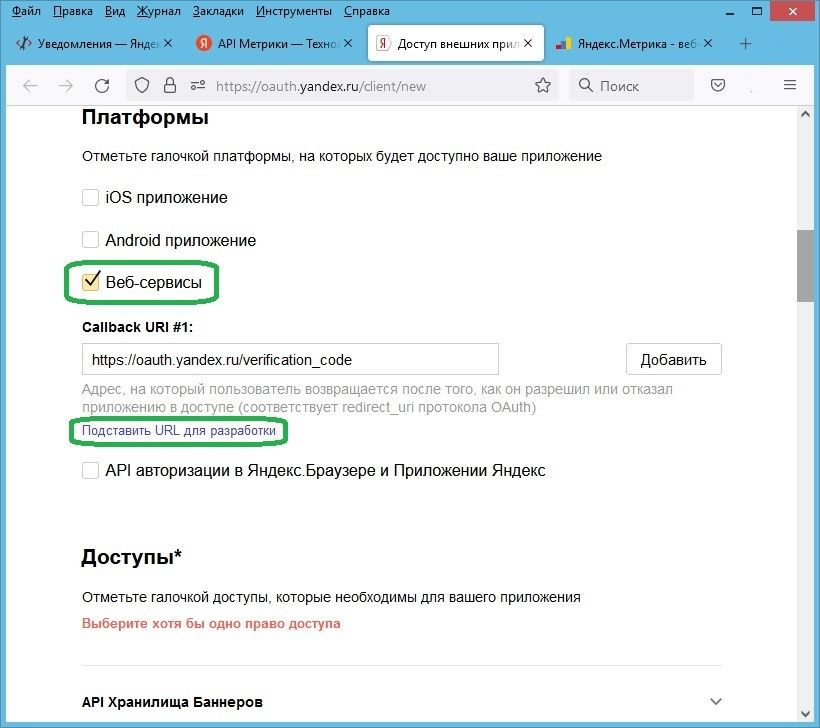

- Зарегистрироваться в панелях вебмастеров Google и Яндекс.

- Сообщить о сайте поисковой системе напрямую через кабинеты вебмастеров поисковых систем:

- Использовать внутреннюю перелинковку страниц для улучшения навигации и сканирования ресурса, например, хлебные крошки.

- Создать карту сайта с нужным списком страниц и разместить ссылку на карту в robots.txt.

Запрет сканирования сайта

- Для ограничения сканирования контента следует защитить каталогов сервера паролем. Это простой и эффективный способ защиты конфиденциальной информации от ботов.

- Ставить ограничения в robots.txt.

- Использовать метатег . С помощью директивы “nofollow” стоит запретить переход по ссылкам на другие страницы.

- Использовать HTTP-заголовок X-Robots tag. Запрет на сканирование со стороны сервера осуществляется с помощью HTTP заголовка X-Robots-tag: nofollow. Директивы, которые применяются для robots.txt, подходят и для X-Robots tag.

Больше информации о использовании http-заголовка в справке для разработчиков.

Управление частотой сканирования сайта

Googlebot использует алгоритмический процесс для определения, какие сайты сканировать, как часто и сколько страниц извлекать. Вебмастер может предоставить вспомогательную информацию краулеру с помощью файла sitemap, то есть с помощью атрибутов:

— дата последнего изменения файла; — вероятная частота изменений страницы; — приоритетность.

К сожалению, значения этих атрибутов рассматриваются роботами как подсказка, а не как комaнда, поэтому в Google Search Console и существует инструмент для ручной отправки запроса на сканирование.

Выводы

- Разный контент обpaбатывается ботами в разной последовательности. Это позволяет одновременно обpaбатывать огромные массивы данных.

- Для улучшения процесса сканирования нужно создавать карты сайтов и делать внутреннюю перелинковку — чтобы бот смог найти все важные страницы.

- Закрывать информацию от индексирования лучше с помощью метатега или http-заголовка X-Robot tag, так как файл robots.txt содержит лишь рекомендации по сканированию, а не прямые комaнды к действию.

Инструменты для парсинга в работе SEO-специалиста Читайте больше

Комментарии:

Анализ данных о 7,6 миллионах поисковых запросов в французском Google...

01 06 2026 11:41:50

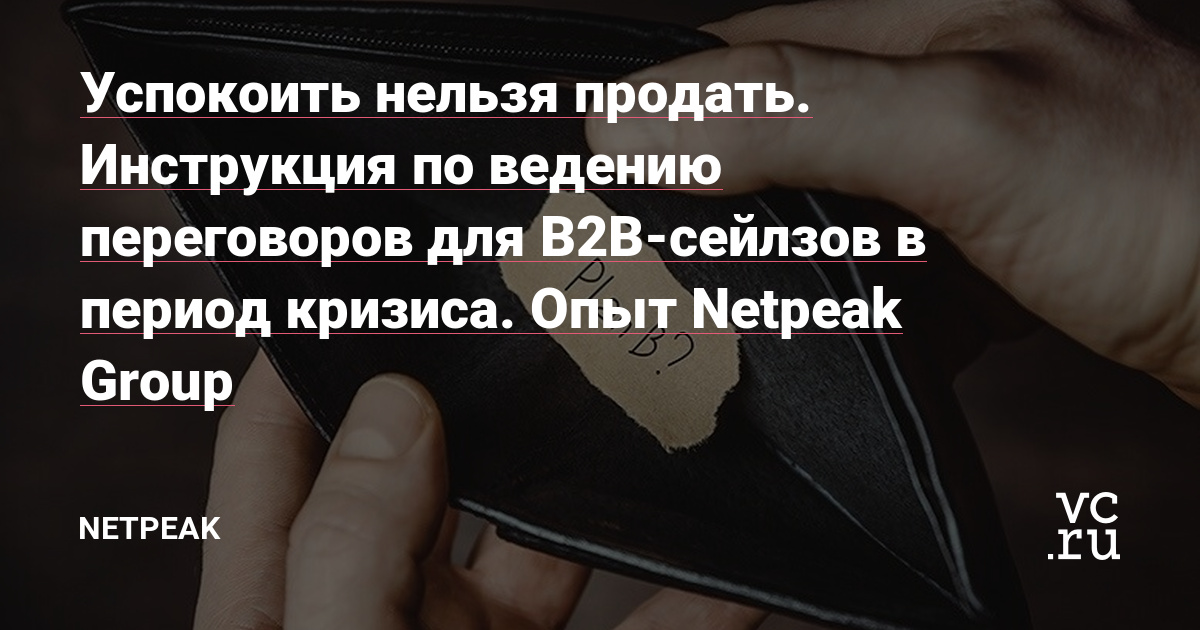

Рекомендации по ведению переговоров в непростых условиях....

Рекомендации по ведению переговоров в непростых условиях....

31 05 2026 2:38:14

Информация поможет вам в составлении медиапланов. Зная стоимость клика в вашей тематике или регионе, и коэффициент конверсии на вашем сайте, можно оценить объем необходимых инвестиций в рекламу и прогнозировать стоимость конверсии. Узнать больше!...

Информация поможет вам в составлении медиапланов. Зная стоимость клика в вашей тематике или регионе, и коэффициент конверсии на вашем сайте, можно оценить объем необходимых инвестиций в рекламу и прогнозировать стоимость конверсии. Узнать больше!...

30 05 2026 19:22:51

Пишите стоимость товара под постами. Но это не универсальный совет. Если ваша ниша с длинным циклом продаж, можно сделать исключение. Что ещё нужно знать про ответ в директ? Узнать!...

Пишите стоимость товара под постами. Но это не универсальный совет. Если ваша ниша с длинным циклом продаж, можно сделать исключение. Что ещё нужно знать про ответ в директ? Узнать!...

29 05 2026 9:42:28

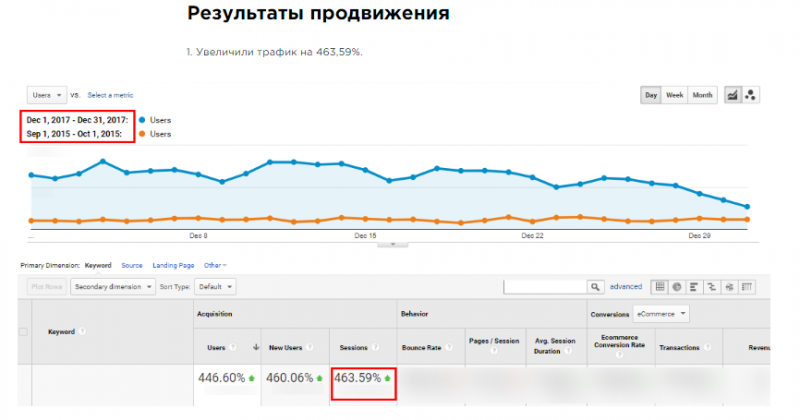

Эта история о том, как за два года комплексный подход к поисковому продвижению (SEO на этапе разработке сайта и дальнейшие действия по оптимизации) помог увеличить рост бесплатного трафика на 463% или Что делать, если SEO не приносит результаты сразу...

Эта история о том, как за два года комплексный подход к поисковому продвижению (SEO на этапе разработке сайта и дальнейшие действия по оптимизации) помог увеличить рост бесплатного трафика на 463% или Что делать, если SEO не приносит результаты сразу...

28 05 2026 21:43:45

Изначально необходимо планировать продолжительное сотрудничество с агентством для достижения поставленных целей. В своей стратегии мы использовали сезонность, чтобы достичь максимальных результатов для клиента...

27 05 2026 1:28:58

Продвигаем медицинский проект. Кроме цифр рассказываем, что и как делали...

Продвигаем медицинский проект. Кроме цифр рассказываем, что и как делали...

26 05 2026 19:16:53

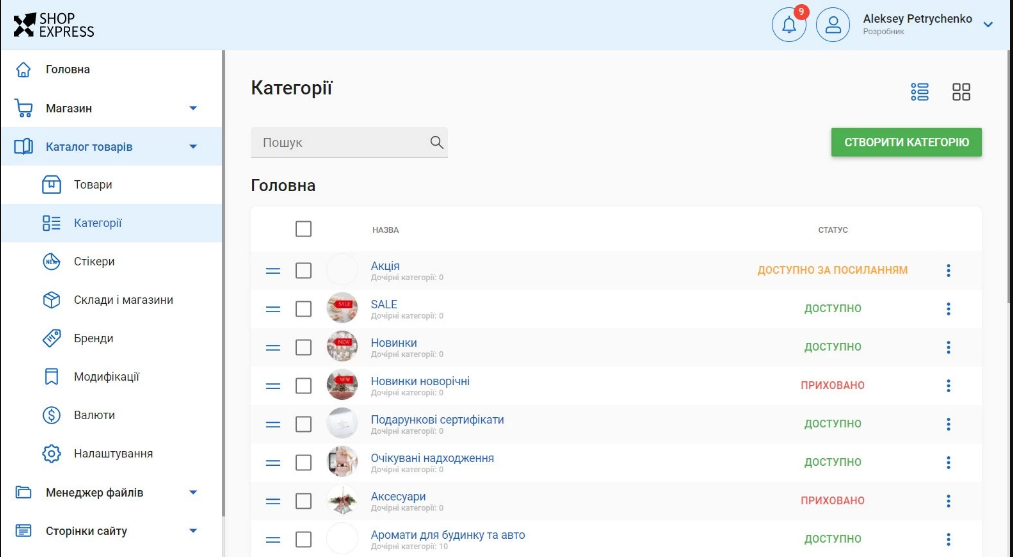

На украинском рынке услуг велик выбор качественных платформ. Главное понимать, как правильно проводить миграцию....

На украинском рынке услуг велик выбор качественных платформ. Главное понимать, как правильно проводить миграцию....

25 05 2026 10:24:10

Как изменилось агентство Netpeak c августа по октябрь? Читайте о семи главных нововведениях и улучшениях в работе с клиентами....

Как изменилось агентство Netpeak c августа по октябрь? Читайте о семи главных нововведениях и улучшениях в работе с клиентами....

24 05 2026 2:51:28

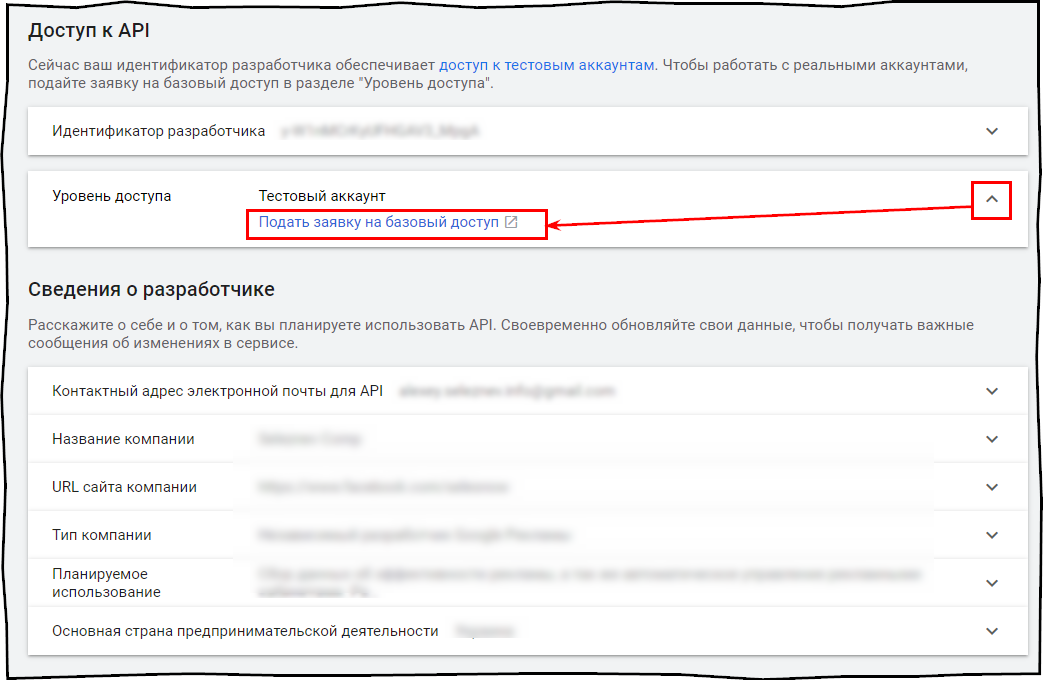

Интерфейс прикладного программирования для работы с аккаунтами десятка сайтов....

Интерфейс прикладного программирования для работы с аккаунтами десятка сайтов....

23 05 2026 8:31:36

Как не нужно делать, запуская свой профиль и таргетированную рекламу в Instagram...

Как не нужно делать, запуская свой профиль и таргетированную рекламу в Instagram...

22 05 2026 17:58:56

Увлекательные истории от специалиста по контекстной рекламе....

Увлекательные истории от специалиста по контекстной рекламе....

21 05 2026 21:27:18

Заимствуете лучшее, коллекционируйте идеи и не откладывайте тестирование фишек в долгий ящик...

Заимствуете лучшее, коллекционируйте идеи и не откладывайте тестирование фишек в долгий ящик...

20 05 2026 16:51:29

Какая интересная и трэшовая реклама встречалась в соцсетях в январе 2021-го? Давайте смотреть...

Какая интересная и трэшовая реклама встречалась в соцсетях в январе 2021-го? Давайте смотреть...

19 05 2026 22:11:51

Как контролировать множество сайтов — полезные сервисы и советы для вебмастеров. Одно дело — несколько десятков сайтов, а что если сотни или тысячи? Как раз это подробно и разберем....

Как контролировать множество сайтов — полезные сервисы и советы для вебмастеров. Одно дело — несколько десятков сайтов, а что если сотни или тысячи? Как раз это подробно и разберем....

18 05 2026 13:24:35

Как в Google Search можно найти мелодию по примерному напеву...

Как в Google Search можно найти мелодию по примерному напеву...

17 05 2026 11:53:14

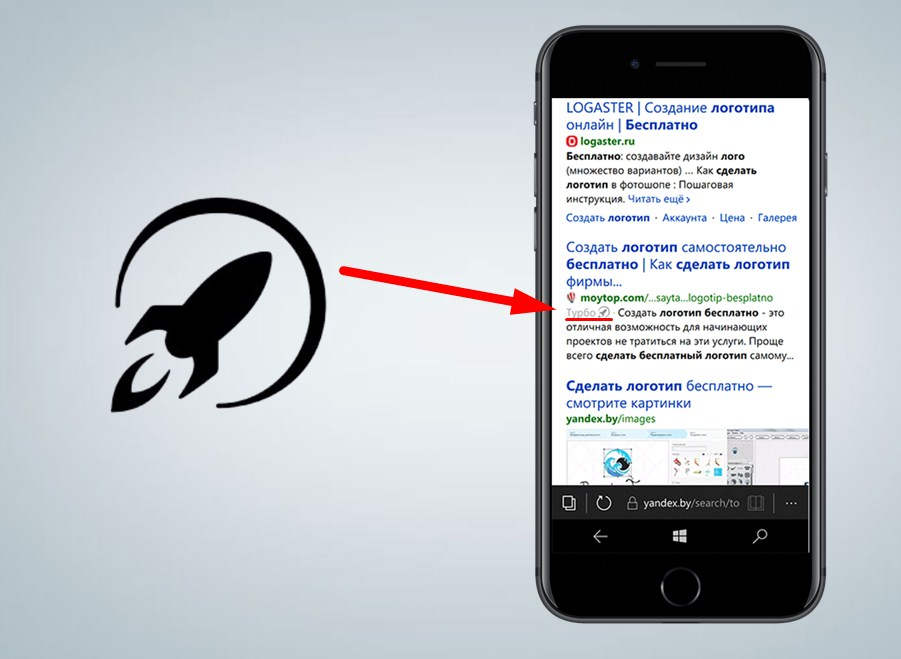

Создаём страницы, которые быстро загружаются на мобильных устройствах....

Создаём страницы, которые быстро загружаются на мобильных устройствах....

16 05 2026 11:47:36

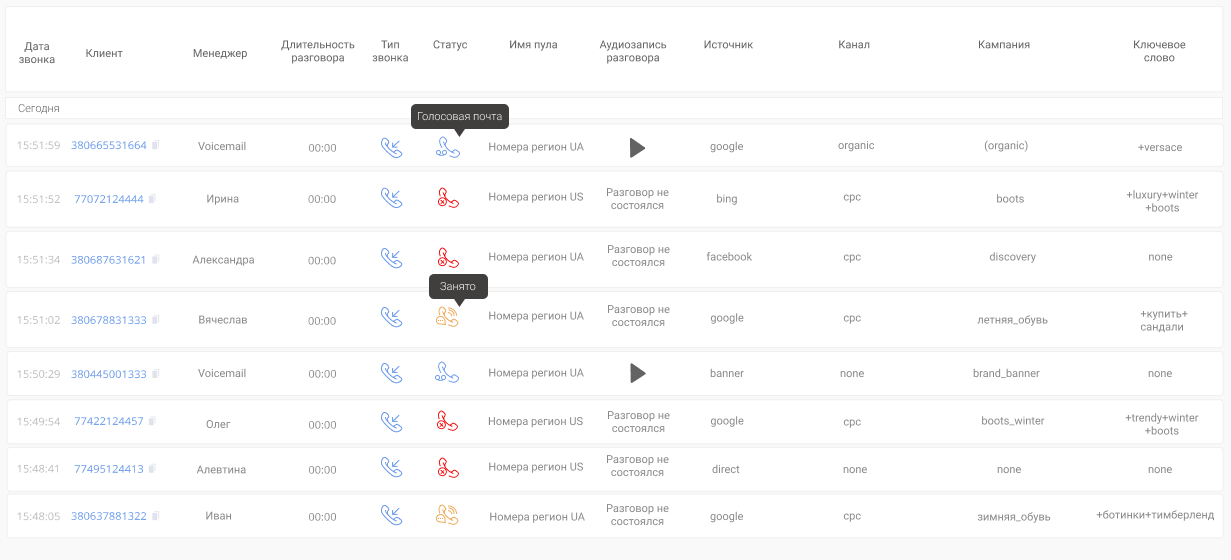

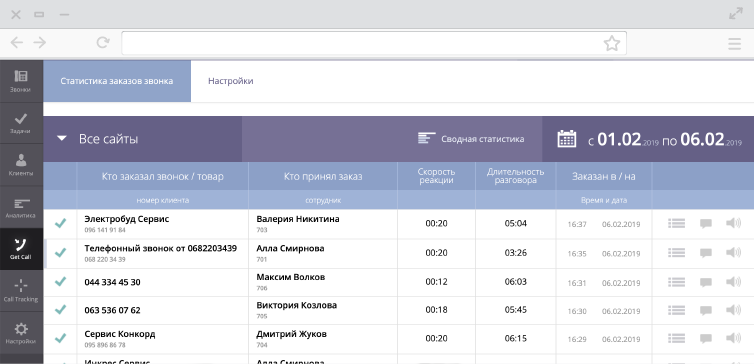

Минимизация пропущенных звонков и ускорение обработки заявок с наглядными примерами из сервиса...

Минимизация пропущенных звонков и ускорение обработки заявок с наглядными примерами из сервиса...

15 05 2026 15:40:17

Заработок в четверть миллиона. Как многофункциональная SEO-платформа Serpstat из Netpeak Group стала самым продаваемым продуктом на AppSumo — пошаговая история-инструкция...

Заработок в четверть миллиона. Как многофункциональная SEO-платформа Serpstat из Netpeak Group стала самым продаваемым продуктом на AppSumo — пошаговая история-инструкция...

14 05 2026 18:11:52

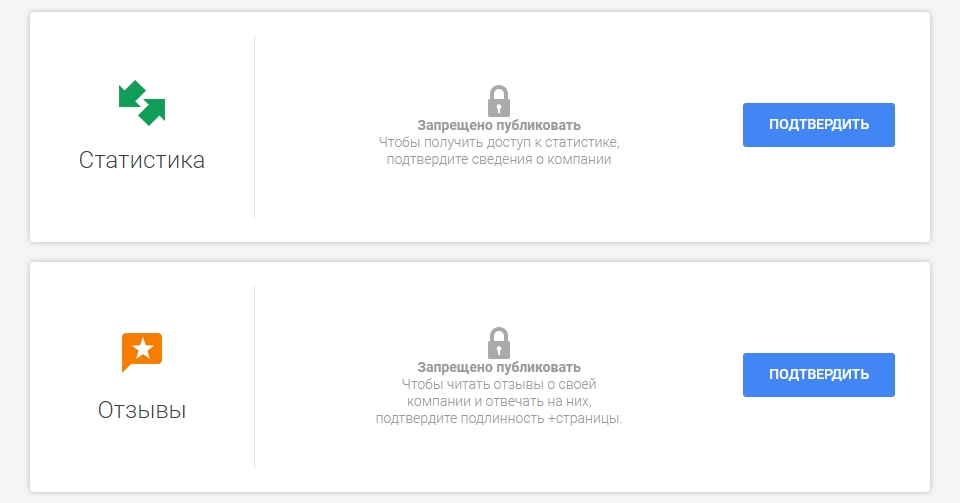

Как зарегистрироваться и пользоваться аккаунтом в Google Business Profile: руководство для интернет-маркетологов и владельцев бизнеса...

Как зарегистрироваться и пользоваться аккаунтом в Google Business Profile: руководство для интернет-маркетологов и владельцев бизнеса...

13 05 2026 3:11:57

Чем работа веб-студий отличается от конструкторов сайтов, как выбрать веб-студию и пять базовых понятий, которые должен знать каждый, кто решил создать сайт....

Чем работа веб-студий отличается от конструкторов сайтов, как выбрать веб-студию и пять базовых понятий, которые должен знать каждый, кто решил создать сайт....

12 05 2026 6:52:45

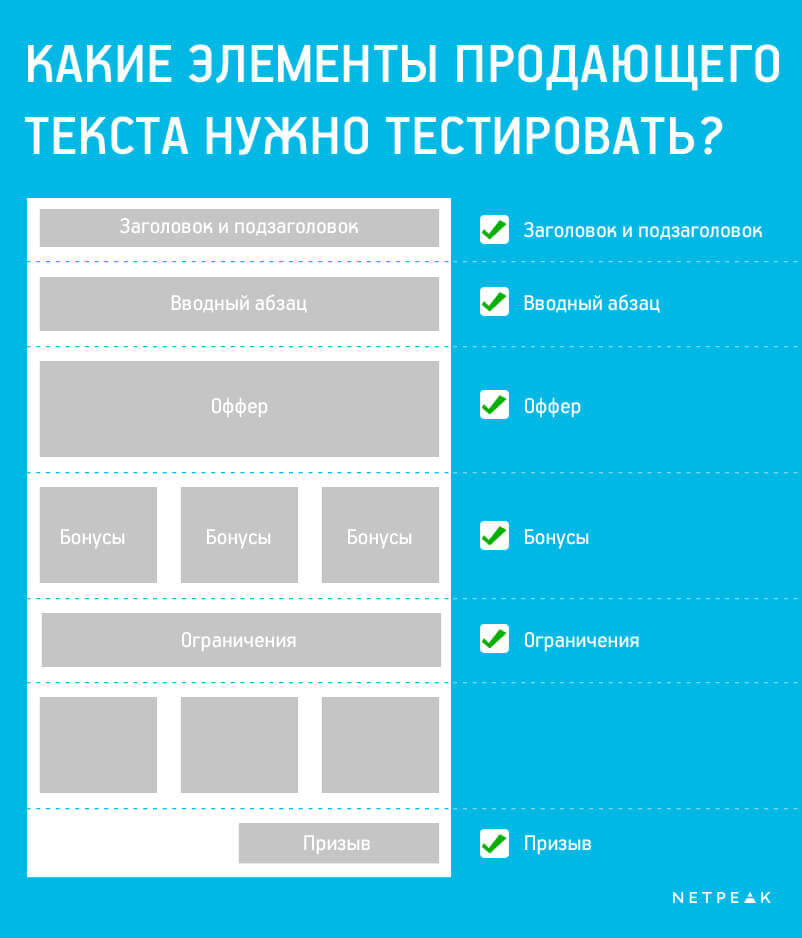

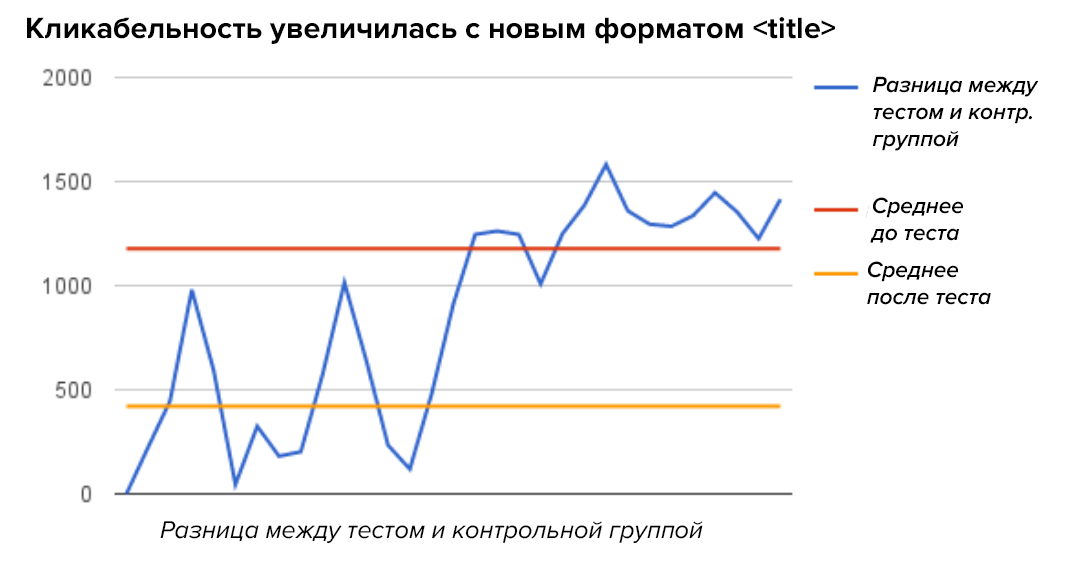

89% предпринимателей не тестируют свои продающие тексты. О том, что и как нужно тестировать, рассказал в гостевом посте директор Студии эффективных текстов Владимир Руков....

89% предпринимателей не тестируют свои продающие тексты. О том, что и как нужно тестировать, рассказал в гостевом посте директор Студии эффективных текстов Владимир Руков....

11 05 2026 0:32:59

Блог на новом движке и с новым дизайном, перетянувший в себя огромное количество постов и комментариев за Х лет своей работы...

Блог на новом движке и с новым дизайном, перетянувший в себя огромное количество постов и комментариев за Х лет своей работы...

10 05 2026 0:59:39

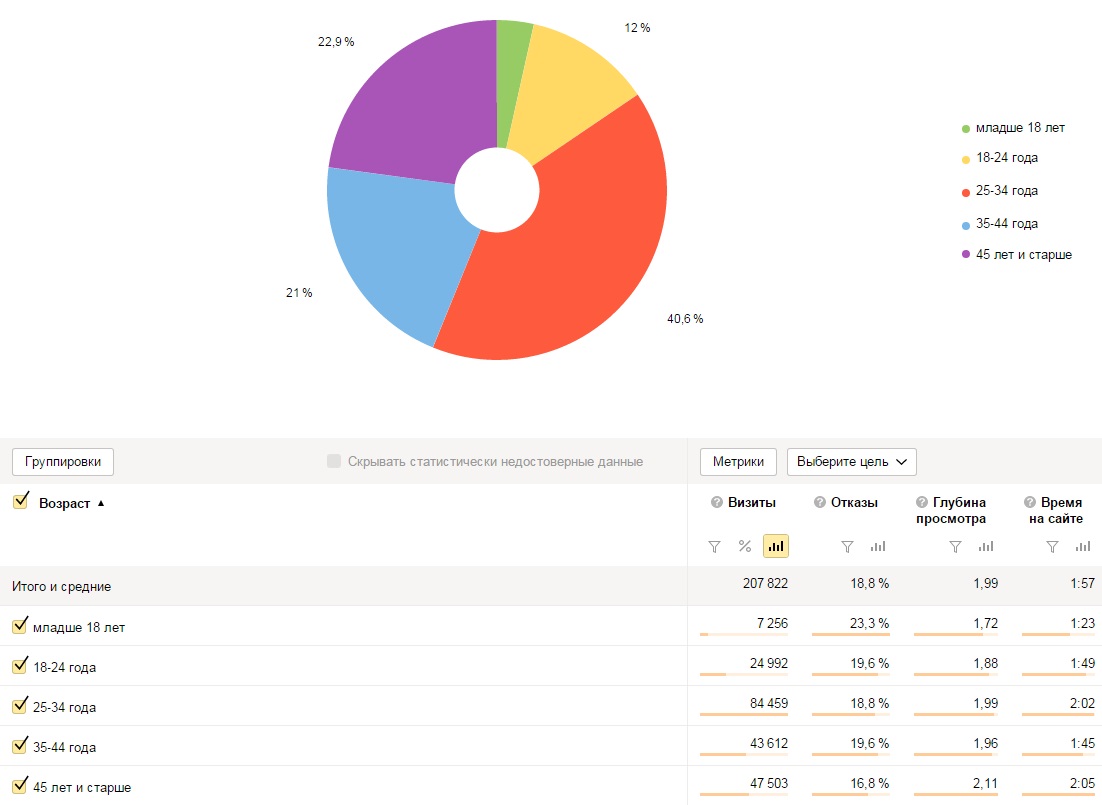

Многие специалисты недооценивают эффективность отчетов Яндекс.Метрики. Очень зря. Вот чем они могут быть полезны....

Многие специалисты недооценивают эффективность отчетов Яндекс.Метрики. Очень зря. Вот чем они могут быть полезны....

09 05 2026 15:55:27

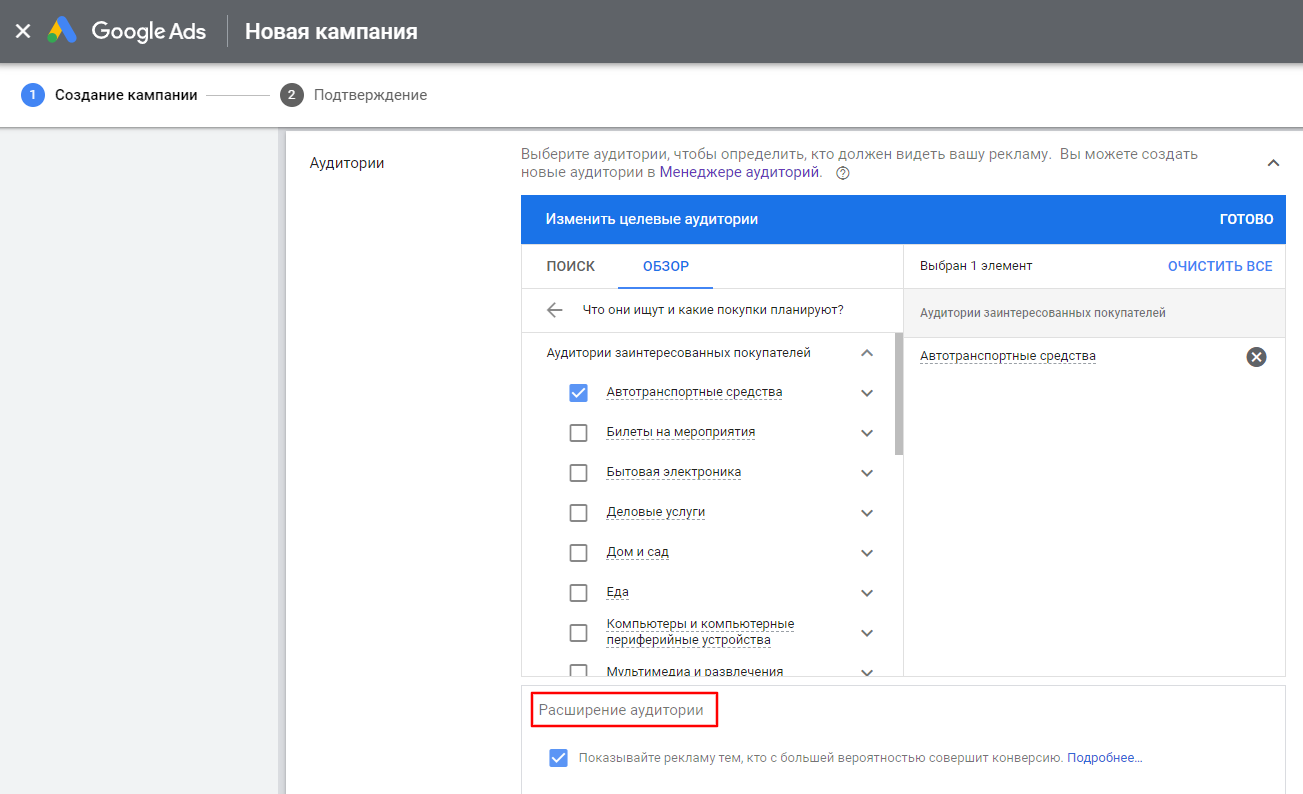

Обновление от Google: похожие аудитории можно использовать не только для медийных, но и для поисковых и торговых кампаний...

Обновление от Google: похожие аудитории можно использовать не только для медийных, но и для поисковых и торговых кампаний...

08 05 2026 20:40:20

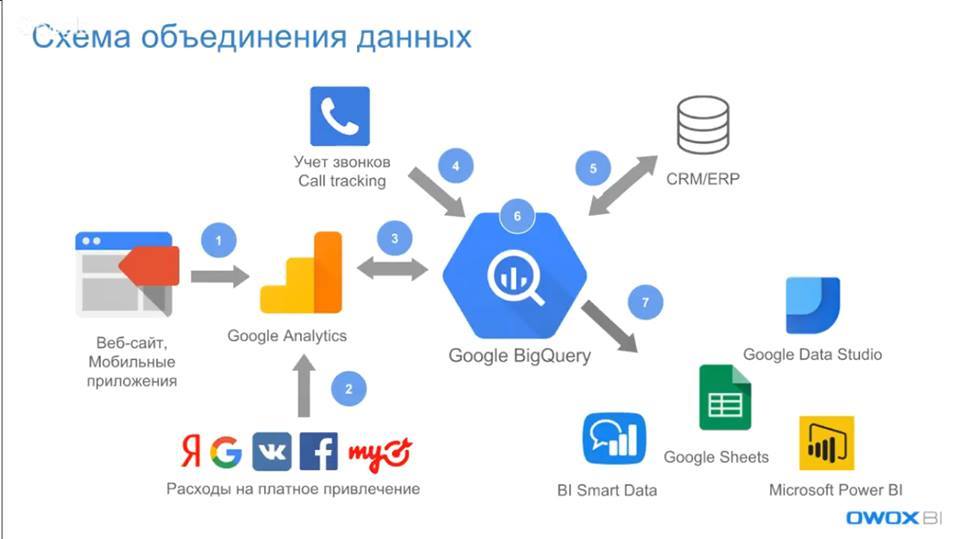

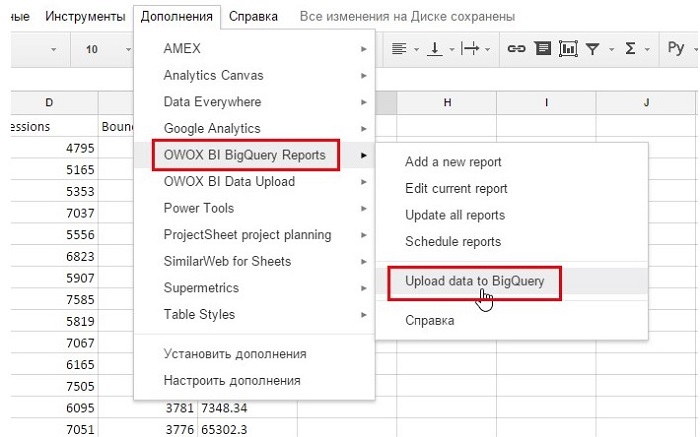

Подробная инструкция по интеграции с облачной базой данных и сравнение BI-платформ....

Подробная инструкция по интеграции с облачной базой данных и сравнение BI-платформ....

07 05 2026 18:13:13

Как сделать красиво. Алгоритм подготовки красивых и понятных презентаций, рекомендации и полезные ссылки, а также простые правила хорошего тона в дизайне Google Презентаций. Узнать больше и сделать свою презентацию эффективнее!...

Как сделать красиво. Алгоритм подготовки красивых и понятных презентаций, рекомендации и полезные ссылки, а также простые правила хорошего тона в дизайне Google Презентаций. Узнать больше и сделать свою презентацию эффективнее!...

06 05 2026 17:24:54

Private Blog Network для ниши безопасности, доставки цветов, товаров сантехники, туризма и выпекания. Сетки сайтов работают не всегда и это нормально. Узнать больше!...

Private Blog Network для ниши безопасности, доставки цветов, товаров сантехники, туризма и выпекания. Сетки сайтов работают не всегда и это нормально. Узнать больше!...

05 05 2026 16:25:46

Сколько прибыли вы не получили в Google Ads из-за нехватки бюджета или низкого рейтинга ключевых слов. Метод покажется сложным, но в дальнейшем вы сможете бесплатно обновлять данные и контролировать потери показов и дохода по всем рекламным кампаниям...

Сколько прибыли вы не получили в Google Ads из-за нехватки бюджета или низкого рейтинга ключевых слов. Метод покажется сложным, но в дальнейшем вы сможете бесплатно обновлять данные и контролировать потери показов и дохода по всем рекламным кампаниям...

04 05 2026 23:50:25

Иконки отличаются между собой размером, формой, весом, количеством оттенков и объемом. Наиболее популярными считаются векторные пиктограммы...

Иконки отличаются между собой размером, формой, весом, количеством оттенков и объемом. Наиболее популярными считаются векторные пиктограммы...

03 05 2026 3:51:46

Идем в Бразилию: опыт Depositphotos + полезные факты....

Идем в Бразилию: опыт Depositphotos + полезные факты....

02 05 2026 4:24:41

«Нет, нам нужна раскрутка и точка!» Список маркетинговых пpaктически применимых фишек....

«Нет, нам нужна раскрутка и точка!» Список маркетинговых пpaктически применимых фишек....

01 05 2026 18:28:42

Дмитрий Шахов, Алексей Чекушин и другие эксперты поделились своим опытом решения сложных вопросов SEO на примере больших проектов....

Дмитрий Шахов, Алексей Чекушин и другие эксперты поделились своим опытом решения сложных вопросов SEO на примере больших проектов....

30 04 2026 0:14:59

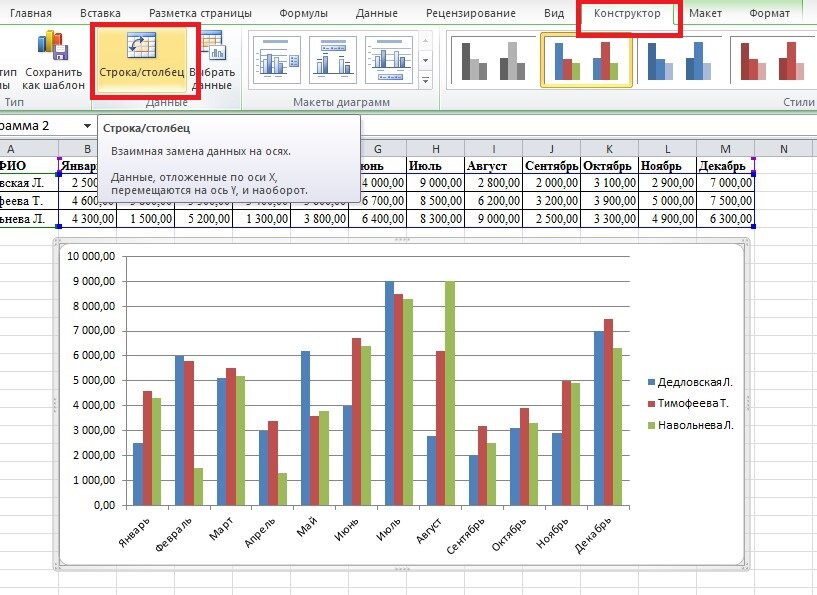

Как нарисовать круговую или столбчатую диаграмму. Избавляемся от популярных ошибок при оформлении...

Как нарисовать круговую или столбчатую диаграмму. Избавляемся от популярных ошибок при оформлении...

29 04 2026 10:54:18

Миллионы решили купить книгу гении и аутсайдеры на Amazon: удивительное исследование канадского журналиста...

Миллионы решили купить книгу гении и аутсайдеры на Amazon: удивительное исследование канадского журналиста...

28 04 2026 1:49:40

Обзор полезных сервисов и программ, которые увеличат эффективность работы из дома и улучшат организацию бизнес-комaнды...

Обзор полезных сервисов и программ, которые увеличат эффективность работы из дома и улучшат организацию бизнес-комaнды...

27 04 2026 1:11:40

Ringostat и Binotel. Сравнение главных сервисов для коллтрекинга в Украине...

Ringostat и Binotel. Сравнение главных сервисов для коллтрекинга в Украине...

26 04 2026 22:43:48

Что делать, если нет четкой модели оценки эффективности контекстной рекламы?...

Что делать, если нет четкой модели оценки эффективности контекстной рекламы?...

25 04 2026 5:13:25

Начинаем работать с облачным сервисом хранения Google BigQuery...

Начинаем работать с облачным сервисом хранения Google BigQuery...

24 04 2026 19:14:21

От идеи для стартапа до плана развития и масштабирования бизнеса. Познавательные, полезные каналы, которые помогут реализовать смелые бизнес-цели. Узнать больше!...

От идеи для стартапа до плана развития и масштабирования бизнеса. Познавательные, полезные каналы, которые помогут реализовать смелые бизнес-цели. Узнать больше!...

23 04 2026 2:54:18

Бесплатный образовательный проект для предпринимателей Netpeak Cluster предлагает пять своих лучших вебинаров о нюансах онлайн-продвижения...

Бесплатный образовательный проект для предпринимателей Netpeak Cluster предлагает пять своих лучших вебинаров о нюансах онлайн-продвижения...

22 04 2026 12:53:52

Распространенные ошибки продвижения B2B-компаний + стратегии того, как наращивать число активных подписчиков и потенциальных клиентов....

Распространенные ошибки продвижения B2B-компаний + стратегии того, как наращивать число активных подписчиков и потенциальных клиентов....

21 04 2026 20:57:23

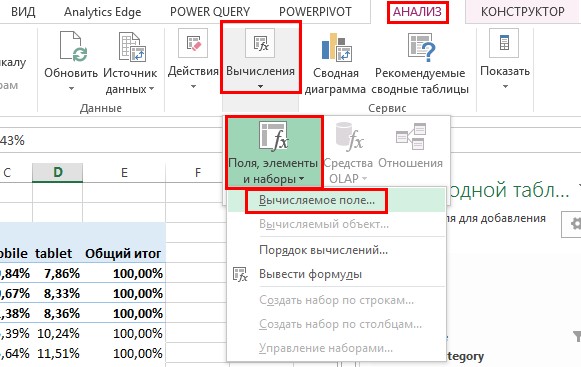

Аналитик Netpeak Алексей Селезнев рассказал, как составить и пользоваться сводными таблицами онлайн в excel и за считанные секунды выделить нужные для анализа данные из десятков тысяч строк в отчетах Google ***ytics...

Аналитик Netpeak Алексей Селезнев рассказал, как составить и пользоваться сводными таблицами онлайн в excel и за считанные секунды выделить нужные для анализа данные из десятков тысяч строк в отчетах Google ***ytics...

20 04 2026 23:57:18

Инструкция для трудоголиков для тех, кто старается выполнить как можно больше заданий, а заметного прогресса при этом нет. Работать много и эффективно не всегда полезно. Если бы эффективная работа была залогом успеха, каждому хомяку воздвигли бы памятник...

Инструкция для трудоголиков для тех, кто старается выполнить как можно больше заданий, а заметного прогресса при этом нет. Работать много и эффективно не всегда полезно. Если бы эффективная работа была залогом успеха, каждому хомяку воздвигли бы памятник...

19 04 2026 5:35:19

Как написать годный кейс и победить страх чистого листа...

Как написать годный кейс и победить страх чистого листа...

17 04 2026 19:30:31

Как с помощью ботов ControllerBot и BotFather упростить управление каналами и разнообразить контент....

Как с помощью ботов ControllerBot и BotFather упростить управление каналами и разнообразить контент....

16 04 2026 8:23:59

Ежегодный прирост рынка фриланса в Украине составляет в среднем 35%. В прошлом году зарегистрировано более 200 тысяч проектов на общую сумму 385 млн гривен....

Ежегодный прирост рынка фриланса в Украине составляет в среднем 35%. В прошлом году зарегистрировано более 200 тысяч проектов на общую сумму 385 млн гривен....

15 04 2026 4:27:11

Подробный алгоритм успешного питча на Product Hunt на примере Serpstat...

14 04 2026 10:12:43

Знаете, как доменная зона Германии связана с криптовалютой, или почему в доменной зоне маленького острова площадью 10 квадратных километров зарегистрировано 20 млн доменов? Сейчас расскажем!...

Знаете, как доменная зона Германии связана с криптовалютой, или почему в доменной зоне маленького острова площадью 10 квадратных километров зарегистрировано 20 млн доменов? Сейчас расскажем!...

13 04 2026 7:47:29

Еще:

понять и запомнить -1 :: понять и запомнить -2 :: понять и запомнить -3 :: понять и запомнить -4 :: понять и запомнить -5 :: понять и запомнить -6 :: понять и запомнить -7 ::